Dit gebeurde niet in het Midden-Oosten

In de eerste week van de oorlog in het Midden-Oosten worden misleidende en met kunstmatige intelligentie gemaakte beelden veel gedeeld. Miljoenen mensen zagen die. Een vliegtuig dat op spectaculaire wijze ontsnapt aan een raket of een enorme brand in Irak. De beelden ervan lijken echt of recent, maar zijn dat allerminst.

De NOS onderzoekt relevant beeldmateriaal dat op sociale media verschijnt zo snel mogelijk om te kunnen vaststellen of een bepaalde foto of video wel klopt. Zodra we daar zeker van zijn, nemen we het op in onze berichtgeving.

Yorick de Vries is verificatiedeskundige bij de NOS. Door middel van open bronnenonderzoek controleert hij video's op echtheid. Met hem bespreken we vijf misleidende beelden die hij tegenkwam. Andere deskundigen vertellen over het gevaar dat uitgaat van bewuste misleiding met beeldmateriaal.

De Vries: “We zien hier een vliegtuig dat achterna wordt gezeten door een luchtverdedigingsraket. Online worden aan de video de meest wilde claims gehangen, maar dit beeld is nep. Het komt uit een zeer realistische videogame. Voor wie de details niet kent, is dat haast niet te zien. Bijvoorbeeld: een luchtafweerraket explodeert niet als een vuurbal, maar meer als een rookwolk.”

“We zijn de laatste maanden voorbij het cruciale punt waarop je zelf kunt beoordelen of beeld dat je op sociale media ziet echt of nep is”, zegt Pieter van Boheemen van Post-X Society. Zijn stichting onderzoekt desinformatie en poogt ‘antidemocratische ontwikkelingen te stoppen’.

Het valt hem op dat bij groot nieuws steeds vaker nepbeelden verschijnen. “Wil je zeker weten dat beeld op sociale media echt of nep is, dan moet je naast een video ook andere openbare bronnen raadplegen om dat te checken.”

De Vries legt uit: “Dit zou een aanval moeten zijn op Tel Aviv in Israël. Maar je kunt aan meerdere dingen zien dat dit een AI-video is. Bijvoorbeeld aan de kleur van de rook. Een aanval op een oliedepot zorgt bijvoorbeeld voor zwarte wolken, rook van een chemische brand is vaak oranje en een aanval op een luchtverdedigingssysteem geeft over het algemeen witte rook. En dat al deze doelwitten zo dicht op elkaar zitten, in stedelijk gebied, is heel onwaarschijnlijk.”

Wie verspreiden dit soort beelden dan? “Dat wisselt”, legt Van Boheemen uit. “Er zijn mensen die simpelweg aandacht willen, omdat ze aan veelbekeken video’s geld verdienen. Maar vaak is het ook groter of ideologischer dan dat.”

Peter Burger van de Universiteit Leiden is gespecialiseerd in nepnieuws. “Voor sommige landen of regimes is het ook een vorm van militaire propaganda. Nepvideo’s gaan dan rond om de andere partij zwart te maken of eigen successen op te hemelen.”

“Dit zou beeld zijn van een grote brand na een aanval in Erbil in Irak. Wat me direct opviel was dat dit de enige foto van de brand was, terwijl er honderdduizenden mensen in Erbil wonen. Dat is al opmerkelijk", zegt De Vries.

"Uiteindelijk bleek dat het beeld van de felle brand wel was gebaseerd op bestaande beelden van een drone-inslag, maar dat de brand overdreven groot werd gemaakt met kunstmatige intelligentie.”

Desinformatie-specialist Van Boheemen noemt vijf strategieën van kwaadwillenden. “In het Engels zijn dat de 5D’s. Distort: verstoren. Distract: afleiden. Dismay: mensen wanhopig maken. Divide: mensen verdelen. En dismiss: ontkennen.” Op al deze manieren proberen mensen achter de nepbeelden een debat te beïnvloeden of verdeling te zaaien.

En die strategieën worden soms ook op onverwachte momenten zichtbaar. “Bijvoorbeeld toen een aantal weken geleden het internet in Iran was platgelegd. In Schotland merkten ze dat op pagina’s van een Schotse onafhankelijkheidsbeweging opvallend minder berichten werden geplaatst. Het vermoeden is dat Iraanse bots en mensen achter accounts die de politiek in het Verenigd Koninkrijk proberen te beïnvloeden toen niet op internet konden.”

Verificatie-expert De Vries: “Dit is een Israëlische luchtaanval in Teheran. Het beeld is echt, de locatie klopt. Maar dit is geen beeld uit deze oorlog, maar van aanvallen van Israël op Iran in juni 2025. Wil je zoiets controleren, dan kun je het eerste beeld van de video nemen en dat uploaden in een zoekmachine. Zo zie je wanneer beeld al eerder is verschenen.”

"De gevolgen van dat zo veel mensen misleidende beelden zien, zijn groot", zegt Van Boheemen. “Dat mensen extreem beeld ‘gewoon’ gaan vinden, kan leiden tot afvlakking. Alles kan waar zijn en tegelijkertijd kan niets waar zijn. Dan kun je gaan denken: laat maar.”

“Het hele democratische systeem is erop gebaseerd dat iedereen meedoet, maar als mensen niet meer weten wat te vertrouwen, dan houdt dat ergens op.” En daar sluit Burger zich bij aan: “Je wilt niet dat mensen alles klakkeloos geloven, maar het moet ook zeker niet zo zijn dat mensen alles direct verwerpen als onbetrouwbaar.”

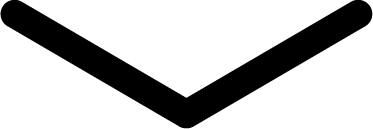

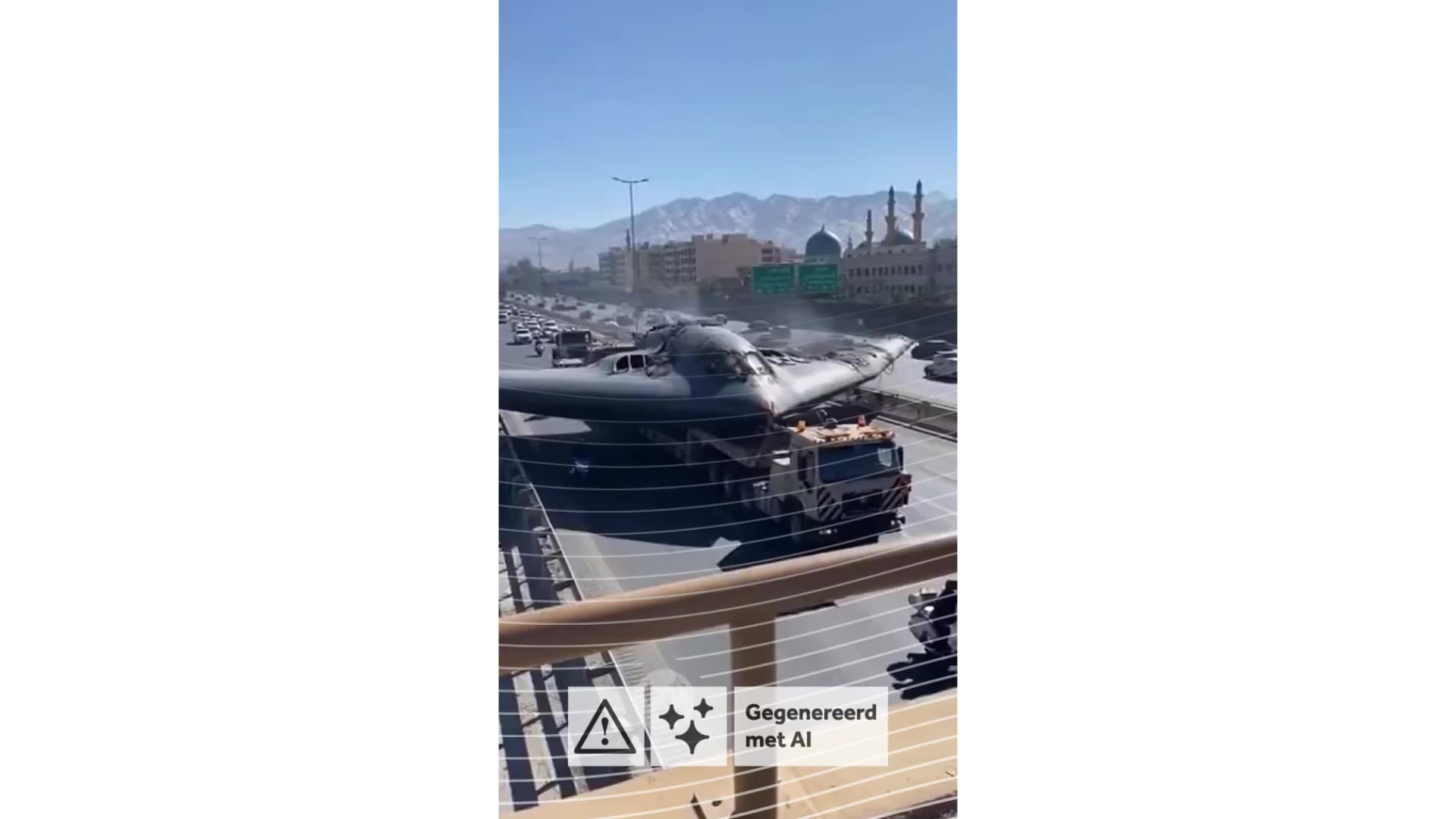

De Vries: "Hier ligt een Amerikaanse bommenwerper op een Iraanse oplegger. Maar als je op de details let, kun je ontdekken dat dit een AI-video is. Zo is bijvoorbeeld ineens een geel vlaggetje te zien dat er daarvoor nog niet was. Bovendien is het vreemd dat de bommenwerper nog altijd rookt. En later in de video verandert de schade aan de neus. Dat is kenmerkend aan veel AI-video's: details zijn vreemd of ontstaan of veranderen plots."

"Maar wat vooral opvalt: dit is too good to be true. De suggestie wordt gewekt dat in Iran een zeer geavanceerde Amerikaanse bommenwerper is neergehaald. Dat de Iraanse luchtmacht daartoe in staat zou zijn, laat staan om die vervolgens op een vrachtwagen te tillen en onder de constante druk van Israël en de VS trots rond te paraderen, is onmogelijk."

Verificatiedeskundige De Vries geeft drie tips die je kunt toepassen om niet misleid te worden met beelden: “Baseer je niet alleen op wat je in je tijdlijn ziet, daar kan onbetrouwbare informatie opduiken. Zoek betrouwbare nieuwsbronnen of nieuwskanalen.

Twee: AI-beelden zien er weliswaar overtuigend uit, maar kloppen vaak niet op detailniveau. Let daar op.

En drie: één beeld is geen beeld. Raadpleeg meer betrouwbare bronnen of zoek verschillend beeld van hetzelfde incident.”

Colofon

Redactie Jeroen Gortworst

Eindredactie Jurjen IJsseldijk

Research Yorick de Vries

Ontwerp Thijs Geritz