Like het ijsje en duik er met ons in

Bij YouTube, Insta, je bank, verzekeraar: overal zijn algoritmes achter de schermen voor je aan het werk. Maar wacht even: algoritmes? Wat bedoelen ze daar eigenlijk mee? En welke rol spelen die in ons leven?

Eerst de basics: een algoritme is eigenlijk niets meer dan een reeks instructies. Een recept of stappenplan.

Bijvoorbeeld: een webshop laat je automatisch t-shirts zien als de zon schijnt en regenjassen als het regent.

Maar gaat het over het Insta-algoritme, of een leeralgoritme dat de overheid gebruikt, dan gaat het over complexe computersystemen die voorspellingen kunnen maken en patronen kunnen herkennen in grote bergen data.

Van voorspellingen over de film die je hierna wil zien of een advertentie waar je wél op zit te wachten, tot de hoogte van je verzekeringspremie.

We duiken er dieper in: wat als jij bij een ijscoman het perfecte ijsje wil kopen?

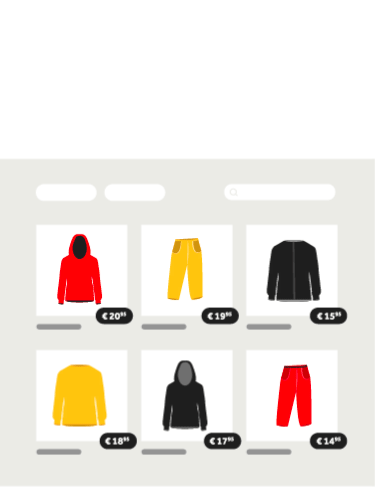

Dan kun je natuurlijk kiezen uit de twaalf op de menukaart, maar de kans is klein dat het perfecte ijsje erbij zit.

Als er 24 op de menukaart staan, is de kans al wat groter - maar de keuze ook moeilijker.

Laat staan dat je de keus had uit honderden, duizenden ijsjes.

Dan wordt zelf kiezen onmogelijk. Maar de kans dat jouw ultieme ijsje ertussen zit, is groot.

Een zelflerend algoritme kan in zo’n situatie aanbevelingen doen: op basis van data over je locatie, het weer, wie je bent, wat je leuk vindt, noem maar op.

Hoe doet ie dat?

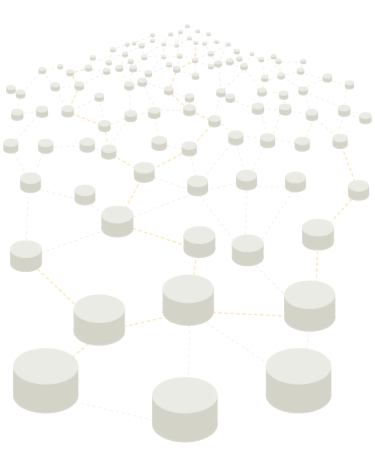

Met die data gaat het algoritme aan de slag. Dat is zo geprogrammeerd, dat het zoekt naar verbanden tussen de eigenschappen van klanten en bijbehorende ijsjes.

In het begin heeft dat algoritme het nog regelmatig fout.

Maar het algoritme wordt beter in voorspellen welke twaalf ijsjes iemand wellicht lekker vindt. En het algoritme leert door: op nieuwe klanten.

Een nieuwe klant krijgt twaalf ijsjes te zien. Bij elke keuze die een klant maakt, leert de computer meer over iemands favoriete ijsje.

Bijvoorbeeld: als je in Den Haag woont, kies je aardbei, kinderen willen waterijs en mannen discodip.

Omdat het algoritme een steeds betere voorspelling kan doen, kan de ijskaart kleiner worden: twaalf ijsjes worden er acht, acht worden er vier - tot het algoritme met bijna 100 procent zekerheid één ijsje aan je voor kan schotelen.

Dit is allemaal gebeurd voor jij bij de ijscoman staat om een ijsje te kopen. Jij krijgt een ijsje met behulp van het inmiddels volleerde algoritme.

Je krijgt een persoonlijke klantenkaart van de ijsverkoper. Daarmee krijgt de ijsverkoper informatie over jou: je huidige locatie, waar je woont, wanneer je ijsjes koopt en wat je interesses zijn.

Die info voedt de ijsverkoper aan het - nu heel slimme - algoritme. De ijscomputer vergelijkt jouw eigenschappen met die van alle andere klanten. En voorspelt zo precies welk ijsje jij wil hebben.

De ijscomputer vergelijkt jouw eigenschappen met die van alle andere klanten. En voorspelt zo precies welk ijsje jij wil hebben.

Maar…

...er zitten keerzijden aan de afhankelijkheid van een algoritme.

Er zijn natuurlijk meer dan twaalf ijsjes die je lekker vindt - en wie weet wil je af en toe wel iets nieuws proberen.

Of weet je helemaal niet dat je eigenlijk dol bent op pistache.

Je keuze wordt beperkt door wat een algoritme je voorschotelt. Maar hoe een algoritme op den duur verbanden vindt, is voor mensen bijna niet te doorgronden.

Misschien heeft het algoritme wel ontdekt dat er een verband is tussen iemands afkomst en het ijsje dat ‘ie wil. Of dat vrouwen alleen maar dure ijsjes lekker vinden.

Als het alleen om ijsjes gaat, zijn de gevolgen hierboven nog te overzien. Maar als een algoritme dat de politie gebruikt bepaalt dat iemands afkomst een risicofactor is, is dat etnisch profileren.

Zo kunnen algoritmes leiden tot geautomatiseerde vooroordelen, waarschuwen critici.

Ze maken zich zorgen over grote bedrijven en overheden die in toenemende mate gebruik maken van dit soort algoritmes. Kijk maar mee:

Alle YouTube-video’s kijken kan niet. Daarom kiest het algoritme voor je en beveelt het video’s aan waarvan de kans het grootst is dat jij ‘m kijkt. En dat werkt behoorlijk goed.

Te goed misschien wel, bewijst dit verhaal van The New York Times. Video's van kinderen in zwembroekjes werden nog eens extra aanbevolen aan mensen die daar volgens het YouTube-algoritme al graag naar keken. Omdat dat algoritme niet doorheeft dat iets moreel verwerpelijk is, doet het gewoon waar het voor gemaakt is. Tenzij morele randvoorwaarden bewust worden ingeprogrammeerd. Maarja, leg moraliteit maar eens uit aan een computer.

De overheid gebruikt op grote schaal voorspellende algoritmes. Om fraude en criminaliteit op te sporen, om in zorgbehoefte in te schatten of te berekenen wat de kans is dat iemand voortijdig schoolverlater wordt.

Het probleem is dat je gegevens uit het verleden in het algoritme stopt, zegt kenners. Door zulke dingen te automatiseren is er een risico op het automatiseren van discriminatie.

Een bank beslist op basis van uitgebreid onderzoek of je kredietwaardig genoeg bent om een lening af te sluiten. Maar dat kost tijd en geld. Dus: als een algoritme het werk doet, is het binnen een minuutje gepiept.

De grote maar: het algoritme kan niet uitleggen waarom je een lening níet zou krijgen. Gebaseerd op jouw data heeft het allerlei verbanden gemaakt, maar kan niet terughalen welk stukje data deed besluiten om een negatief advies af te geven. Was dat omdat je in Leeuwarden woont, omdat je vrouw bent, of toch vanwege je inkomen? Of vanwege de combinatie?